이 글은 서울대학교 컴퓨터공학세미나를 듣고 정리한 것으로

내용을 읽고 관심이 생기면,

이 수업을 연 서울대학교 컴퓨터공학부 사이트

컴퓨터공학세미나 | 서울대학교 컴퓨터공학부 (snu.ac.kr)

컴퓨터공학세미나 | 서울대학교 컴퓨터공학부

cse.snu.ac.kr

혹은

서울대학교 AI연구원 사이트를 방문해보아도 좋을 듯하다.

2021년 2학기 서울대학교 컴퓨터공학세미나 수업은

각 대학의 인공지능대학원 센터장 / 인공지능 관련 벤처기업의 연사가 오셔서

강연을 하는 것으로 진행될 예정이라고 한다.

1. 인공지능연구원 장병탁 교수님

- AI연구원

- 인공지능의 진화

머신러닝의 진화

1. machine learning

AI , 기계학습 원리, 종류, 모델

2. Deep Learning

CNN, RNN, VAE, GAN, GPT

3. Human-level learning

human level AI, long learning, video, lifelog

4. autonumous learnig

general intelligence, universal learning machine

5. future of AI

1. machine learning

AI , 기계학습 원리, 종류, 모델

i) 머신러닝이란?

환경으로부터 획득한 데이터를 바탕으로 모델을 구성하여 스스로 성능을 향상하는 시스템

- 인공지능 관점 : self-improving

- 데이터 마이닝 관점 : data-driven modeling

- 컴퓨터 공학 관점 :

ii) 머신러닝과 프로그래밍의 차이

사람이 알고리즘을 설계하고 코딩한다. 주어진 답을 출력한다.

기계가 단순히 실행하는 게 아니라, 학습하는 데도 컴퓨터를 쓴다.

iii) 머신러닝의 중요성

- 사람이 설계하기 어려운 알고리즘을 해결할 수 있다. 데이터만 가지고.

- bigdata/computer power - GPU /mobile services

iv) 머신러닝의 원리

신경 세포를 흉내낸 계산

초기화하면? 0.6이 나온다. 오차를 줄이는 방향으로 시냅스 가중치를 수정한다.

오차역전파

복잡한 신경망이 등장하면, 복잡한데,, 히든 뉴런을 더 많이 써야한다.

AI가 최근에 급격하게 발전하는데, 적정한 기술과 결합하면서 팡 터지가 된다.

Application example

- autonomous land vehicle ALV

nn learns to steer an autonomous vehicle

사람이 주행하는 것.

iii) 학습하는 방식에는 3 가지가 있다.

supervised

unsupervised

- reinforcement learning

순차적으로 시간이 관계된다.

sequential decision making을 하는 데 중요하다.

image synthesis - nvidia

무감독 학습으로 GAN 이미지 generate

생성 모델. 확률적인 샘플링으로.

데이터가 많으면, 사람 사진까지 fake로 만들 수 있다.

강화학습의 원리는 시행착오다.

강화학습으로 걷게할 수 있다.

2. Deep Learning

CNN, RNN, VAE, GAN, GPT

i) modern AI - deep learning

데이터가 다양하게 들어갈 수 있다.

우선 통째로 데이터를 주고 자동으로 맡기게 된다. 입력과 출력만 준다.

구조 / 층 개수 / 뉴런 종류 / 커널 종류 등은 정하지만, 나머지는 기계한테 맡긴다.

back propagation 알고리즘이 중요함.

ii) 딥러닝 사례 - 물체 인식

imageNet large-scale visual recognition challenge

120만장을 넣고 구별하는 challenge

iii) 딥러닝 사례 - 알파고

iv) machine translation

딥러닝 향상되었음.

NMT 입력 영어를 한국어로 번역. 학습 데이터를 많이 모아준다.

재귀신경망을 설계해주고, 학습ㅇㄹ 시켜주면, 영어 문자응ㄹ 한국어 문장으로 바꾸어준다.

사람이 이해하기가 어렵다.

기계가 나름의 문법 규칙을 찾아서 사용한다.

-> 진짜 이해한 것인가 ? ㄴㄴ. 기계가 지능이 있다고 판별할 수 있는가?

v) GPT-3 Generative Pre-trained Transformer 3

predicting next word with unsupervised pre-training

GPT-3 사람의 천분의 일 정도임.

300억개의 단원을 가진 문헌을 학습시켰다.

연구 관점에서? 사람이 학습하는 것에 못 미친다.

인공지능이? 인간 수준의 지능. 실세계 일을 수행하려면? 지금 딥러닝도 부족하다.

뇌를 닮은 것을 해야 한다.

3. Human-level learning

human level AI, long learning, video, lifelog

그 이후에 딥러닝이 등장했다.

long learning - 긴 시간 동안 학습할 수 있는 것.

초 단위 / 밀리 세컨 단위로 끊임없이 학습하는 것이 필요하다.

long learning. 스토리 이해한다거나..

learning from cartoon videos - 영상 + 글 + 스토리 + 데이터

video QA를 진행한다.

글 생성 + 영상 생성. 등.

i) long learning projects

project 1 - video story understanding

tv 드라마를 학습시킨다.

드라마의 구조까지도 학습. 또오해영? ㅋㅋㅋ.

학습하지 않는 방향.

neural-level structure learning

spatial-evel structure learning

reasoning with structure

visual stroytelling

visual story = photo sequece + sentence sequence

사진을 보고 스토리 텔링을 생성한다.

multimodel sensor stream data

google glass를 하며 일상생활을 학습.

lifeome

4. autonumous learnig

general intelligence, universal learning machine

5. future of AI

가정에서 돌아다니면서 이해 + 심부름해주는 로봇.

babymind project - 애기들이 어떻게 학습하는가?

- 만져본다.

- 물체인식을 한다.

- 이미지.

- 모방

7. 정리

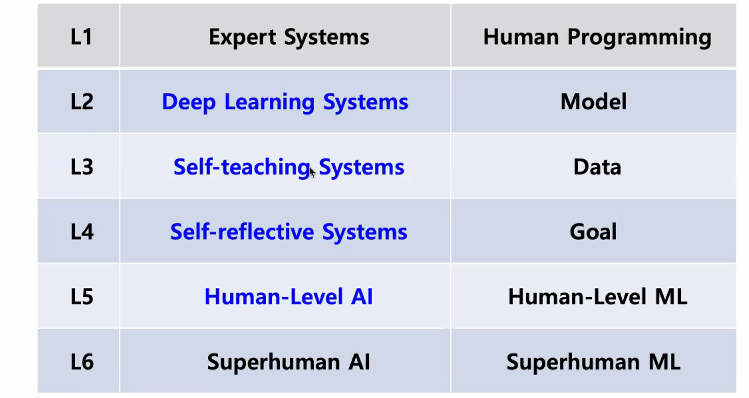

L2

'Computer Science' 카테고리의 다른 글

| Panda3D 3D graphics using python | installation & basic tutorials | 작성 중 (0) | 2021.09.19 |

|---|---|

| 3D computer graphics introduction | CrashCourse (0) | 2021.09.18 |

| IEEE 754 | 부동 소수점 표현법, single precision, biased exponent (0) | 2021.09.07 |

| [8.10] (0) | 2021.08.10 |

| 카톡창 분석하기 (0) | 2021.07.23 |